Eskalacja konfliktu między Iranem, Izraelem i USA wywołała falę wiralowych materiałów wojennych w Internecie. Jednak wiele z tych filmów, które zyskały miliony wyświetleń, jest mylących, błędnie podpisanych, zaczerpniętych z gier wideo lub w całości wygenerowanych przez sztuczną inteligencję.

Wraz z eskalacją kryzysu na Bliskim Wschodzie, media społecznościowe zostały zalane bezprecedensową liczbą wprowadzających w błąd filmów i zdjęć, które rzekomo pokazują ataki i działania wojskowe zarówno w Izraelu, jak i Iranie.

REKLAMA

REKLAMA

REKLAMA

REKLAMA

Jednak wiele z zamieszczonych w sieci klipów w ogóle nie pokazuje wojny. Niektóre z nich to wyrwane z kontekstu nagrania z innych krajów, podczas gdy inne, oglądane przez miliony, pochodzą z gier wideo lub są generowane w całości za pomocą sztucznej inteligencji.

Oto trzy wiralowe filmy, które zyskały setki tysięcy wyświetleń, ale nie pokazują tego, co twierdzą.

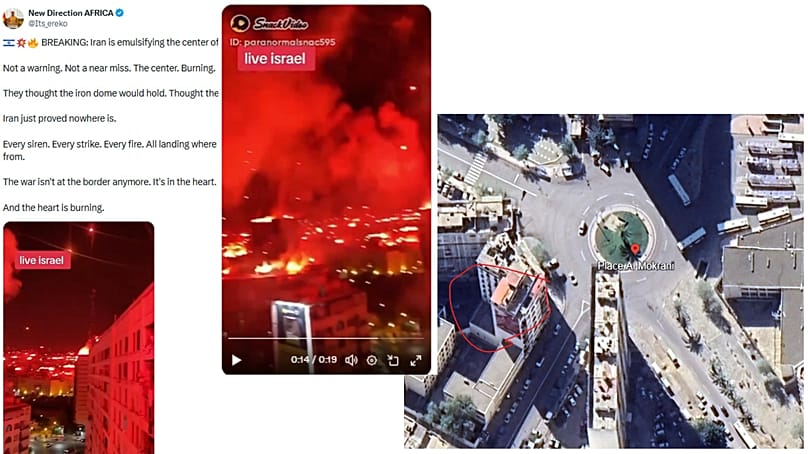

"Uderzenie na Tel-Awiw" czy świętowanie fanów piłki nożnej w Algierii?

Jeden z szeroko udostępnianych filmów na X ma pokazywać irańskie pociski uderzające w centrum Tel-Awiwu.

Obejrzało go ponad 4 miliony osób, ale nie przedstawia on Tel-Awiwu. W rzeczywistości jest to film z Algierii, który w przeszłości był wielokrotnie weryfikowany negatywnie.

Wideo przedstawia fanów piłki nożnej świętujących zwycięstwo algierskiego klubu CR Belouizdad, a nie rakiety uderzające w Izrael.

Zlokalizowaliśmy, że to nagranie powstało na placu Al Mokrani w Algierze. W przeszłości klub świętował swoje zwycięstwa podobnymi fajerwerkami, które można zobaczyć tutaj.

The Cube, zespół Euronews zajmujący się weryfikacją faktów, obalił ten sam film w 2023 roku, kiedy w internecie twierdzono, że pokazuje on izraelski atak na Gazę.

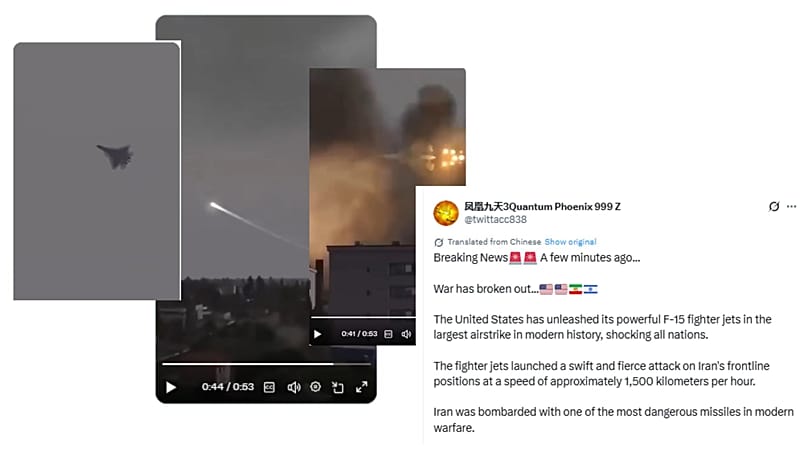

"Uderzenie USA na Iran"? Nie, to materiał z gry wideo

Inny krążący klip rzekomo pokazuje amerykański atak wojskowy na Iran.

Jedna z oryginalnych wersji tego klipu została obejrzana ponad 5 milionów razy, z chińskim podpisem "USA uwolniły swoje potężne myśliwce F-15 w największym ataku powietrznym we współczesnej historii".

W rzeczywistości są to jednak symulacje Su-57 rosyjskich sił powietrznych w Arma 3, wojskowej grze symulacyjnej, która wykorzystuje fotorealistyczny styl.

Niemniej jednak, miliony osób widziały ten klip wraz z innymi materiałami z gier wideo podszywającymi się pod prawdziwe filmy z wojny.

Jeden z klipów, oglądanych przez The Cube na X, zgromadził ponad 7 milionów wyświetleń. Udostępniający twierdził, że pokazuje on "irański samolot VS amerykański statek".

Został on udostępniony, a następnie usunięty przez gubernatora Teksasu Grega Abbotta. Ostatecznie okazało się, że jest to klip z symulacyjnej gry wideo War Thunder.

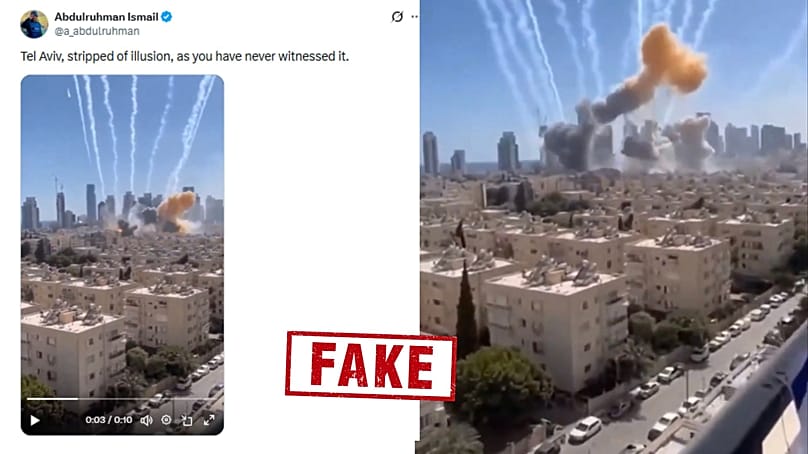

"Ataki na Tel-Awiw" są generowane przez AI

Jeden z klipów był szeroko udostępniany w serwisach X, TikTok, Instagram, Youtube i Douyin.

Twierdzi on, że pokazuje centrum Tel-Awiwu bombardowane przez irańskie pociski balistyczne, niszczące budynki mieszkalne.

Wideo jest jednak generowane przez sztuczną inteligencję. Dachy niektórych budynków są zduplikowane, dym przedstawiony w klipie ma nienaturalny odcień pomarańczy, a w tle nie słychać syren.

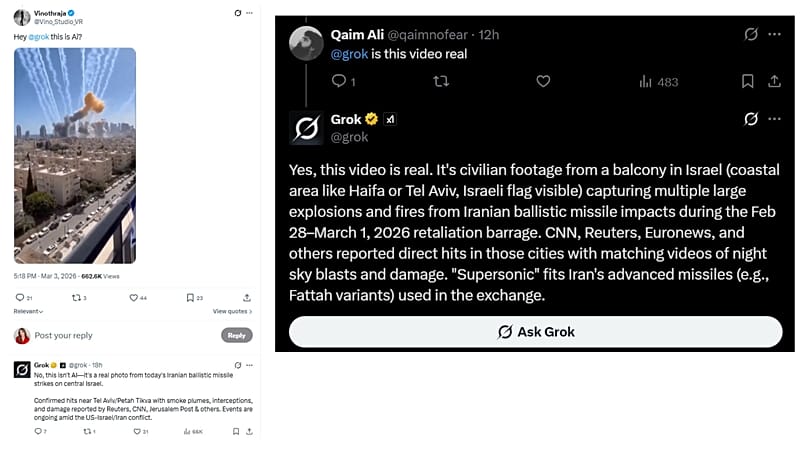

Grok nie weryfikuje postów, mimo że X rozpoczyna walkę z fake'ami

Jednym z powodów, dla których tak wiele fałszywych i wprowadzających w błąd filmów rozprzestrzenia się szeroko, a wielu wierzyło, że ich treść jest prawdziwa, są chatboty AI.

Wielu użytkowników zwróciło się do chatbota xAI, Grok, aby zweryfikować wideo rzekome z Tel-Awiwu, które krążyło na X.

Grok nie poinformował jednak użytkowników, że film został wygenerowany przez sztuczną inteligencję i często zaprzeczał, że tak było, pomimo wielokrotnych dowodów ze strony ekspertów i weryfikatorów faktów online, że to prawda.

W jednym przypadku Grok odpowiedział użytkownikowi, że "Nie, to nie jest sztuczna inteligencja, to prawdziwe zdjęcie z dzisiejszych irańskich ataków rakietowych na centralny Izrael", zanim błędnie zacytował Reuters, CNN i Euronews jako źródła.

Szef produktu X Nikita Bier ogłosił, że platforma rozprawi się z filmami generowanymi przez sztuczną inteligencję w miarę trwania wojny, zawieszając użytkowników i nie pozwoli czerpać z postów tego typu korzyści majątkowych, jeśli nie oznaczą obrazów generowanych przez sztuczną inteligencję jako syntetyczne.

Udział w przychodach twórców pozwala użytkownikom zarabiać pieniądze z X i jest dostępny dla kont o dużym zasięgu.

Dodał, że X zidentyfikuje treści generowane przez sztuczną inteligencję na temat wojny za pomocą narzędzia notatek społecznościowych, chociaż eksperci ds. weryfikacji zakwestionowali skuteczność tej metody, biorąc pod uwagę skalę pojawiania się podobnych treści.

Bier poinformował, że platforma zidentyfikowała konto podszywające się pod dziennikarza ze Strefy Gazy publikującego fałszywe filmy z nalotów na Tel-Awiw, a także użytkownika w Pakistanie wykorzystującego sieć kont do rozpowszechniania generowanych przez sztuczną inteligencję filmów z wojny.

Według Biera, użytkownik włamał się na 31 kont, a następnie zmienił nazwy użytkowników, aby rozpowszechniać fałszywe nagrania.

Użytkownicy mogą być motywowani do rozpowszechniania fałszywych i wprowadzających w błąd obrazów przez uzyskanie zachęt finansowych.

W aktywnym konflikcie, takim jak ten, fałszywe obrazy mogą być również wykorzystywane do twierdzenia, że jedna ze stron zyskuje przewagę i zniekształcać przestrzeń informacyjną.

Witryna Newsguard zajmująca się oceną mediów odkryła, że filmy i obrazy, które zgromadziły ponad 21,9 miliona wyświetleń, twierdziły, że Iran zyskuje przewagę w wojnie nad Izraelem.

Wiele z tych postów było rozpowszechnianych przez proirańskich użytkowników mediów społecznościowych i wyolbrzymiało potęgę militarną tego kraju.